De Analógica a Digital – O Photosite

A Captação da Imagem

Imagens como, por exemplo, esta que agora estamos a ver enquanto escrevemos este texto, já são produzidas em formato digital.

As imagens de 3D virtual, como as dos jogos, já são produzidas pela CPU de acordo com o seu software, e enviadas para a placa gráfica para que sejam realizadas todas as suas operações, no formato digital. São por isso, normalmente, imagens vetoriais (provenientes de gráficos desenhados por funções matemáticas complexas) que após executadas, só precisam de ser rasterizadas (convertidas em pixels) para serem por nós visualizadas.

Mas as imagens que nós captamos visualmente no nosso espaço de vivência são analógicas, isto é, a informação pela qual as percebemos é-nos dada pela nossa visão em concordância com o nosso cérebro e não têm nada de binário. Correspondem a ondas de luz que são recebidas pelas células fotossensíveis da nossa retina. E é precisamente dessa mesma forma que chegam ao sistema ótico de uma câmara fotográfica digital, com a qual registamos essas imagens

Então, como é que essas câmaras digitais já nos fornecem essa mesma imagem em formato digital?

É precisamente isso que vamos tentar entender agora. A imagem é recebida na câmara através da abertura do obturador, e trabalhada pelo sistema ótico. Tudo até agora é idêntico ao que acontece numa câmara fotográfica de filme de 35 mm.

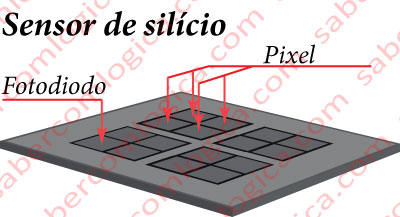

Só que, no lugar do rolo de filme, está um sensor constituído por um chip de silício, conforme a Figura 1. A função deste sensor é capturar a luz e identifica-la, pois o restante processo de tratamento dos dados e armazenamento é executado em separado. Quando se abre o obturador da máquina, o sensor é exposto à luz da imagem que se pretende capturar.

O chip é constituído por fotodiodos. Os fotodiodos são zonas do chip providas de transístores que reagem à exposição da luz, convertendo-a em energia elétrica (eletrões), em quantidade proporcional à intensidade de luz captada.

Mas os fotodiodos captam só a intensidade da luz, não diferenciando a cor. Para reconstruirmos a cor precisamos da informação sobre a intensidade de luz de cada cor RGB. Como é?

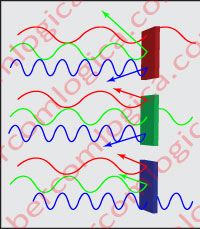

Para que isso seja possível, os fotodiodos são cobertos por filtros de cor que só deixam passar uma das três cores básicas RGB, cada um, como se mostra na Figura 2.

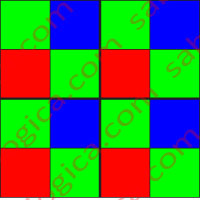

O filtro mais usado para a cobertura dos fotodiodos é o mosaico de Bayer, conforme na Figura 3, constituído por mosaicos de filtros dispostos em conjuntos de matrizes de 2×2, sendo 1 para Red, 2 para Green e 1 para Blue, isto é, 4 filtros, um para cada fotodiodo, sendo que a informação de cada pixel é dada por 4 fotodiodos.

Esta composição resulta do estudo da reação das células óticas do olho humano. O nosso olho tem na retina dois tipos de células óticas:

- Os cones, os principais recetores, que são sensíveis ao vermelho, ao verde e ao azul por diferenciação no comprimento de onda que caracteriza cada uma destas cores básicas. O vermelho é uma onda longa, o verde é uma onda média, e o azul é uma onda curta. Os cones são as células que se encontram no centro da retina.

- Os bastonetes, células que se situam na periferia dos cones, essencialmente sensíveis aos verdes, e responsáveis pela visão periférica e noturna.

Por aqui se percebe facilmente que a visão humana é dominada pelo RGB.

Quando falamos em conjuntos de matrizes de 2×2 mosaicos, referimo-nos à informação que vai corresponder a um pixel, que como já vimos é definida por quantidades de R, G e B.

Portanto, quando se diz que uma determinada câmara fotográfica tem uma resolução de 5 Megapixels, significa que o seu sensor tem 5 milhões de matrizes de 2×2 mosaicos com os respetivos fotodiodos por baixo, portanto 20 milhões de fotodiodos.

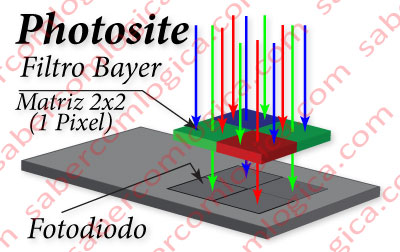

O gráfico da Figura 4 pretende ilustrar o que acabámos de descrever. A luz, com o seu espetro total, incide nos mosaicos, que só deixam passar, em cada caso, aquela cujo comprimento de onda eles não refletem.

Os fotodiodos, colocados por baixo, vão gerar uma intensidade de eletricidade equivalente à intensidade da luz que passa, ou por outras palavras, equivalente à saturação dessa cor.

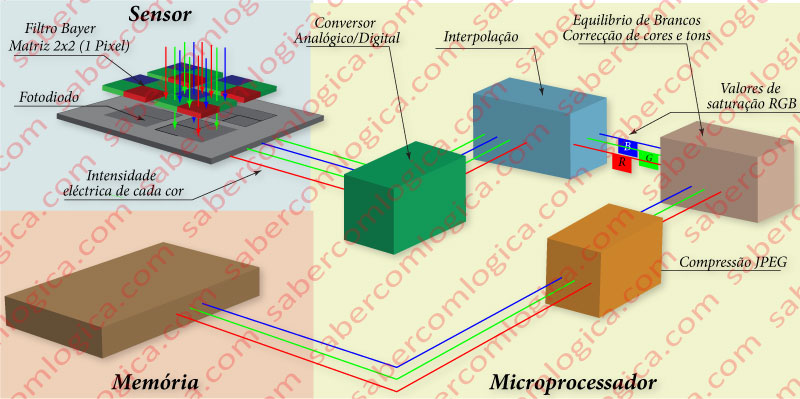

Essa informação, em termos de intensidade elétrica, é comunicada pelo sensor a um microprocessador, que é responsável pela conversão em digital da informação ainda analógica que recebe.

O gráfico da Figura 5 pretende ilustrar a composição desse microprocessador consoante as funções desempenhadas pelo mesmo no processo de digitalização da imagem a partir da informação recebida pelo sensor. Nessa conversão são seguidos os seguintes passos:

Um Conversor Analógico/Digital transforma a informação analógica que recebe do sensor em digital. A intensidade elétrica que recebe corresponderá a uma percentagem da máxima expectável, os 100% da escala representável em 8 bits. À percentagem calculada será atribuído o valor correspondente na escala 0 a 255. Por exemplo, a 20% corresponderá o valor decimal 51 ou o valor binário 00110011.

Interpolação da informação, já binária mas em quatro cores, de forma a obter o valor RGB correspondente. Para isso utilizam-se algoritmos de enorme complexidade convertidos em funções matemáticas, específicos de cada fabricante e matriz de filtro utilizada.

A sensibilidade do silício à cor não é igual à da vista humana. Assim, através de complexos algoritmos específicos de cada marca, convertidos em funções matemáticas que realizarão os elaborados cálculos necessários, os valores RGB até agora obtidos sofrerão:

- Uma correção em termos de balanço de brancos, escolhendo uma área que mais se aproxime do branco puro.

- Uma correção de cor que aproximará a cor obtida pelo silício, aos padrões da cor real que seria vista pelo olho humano.

- Uma correção por anti-aliasing, um processo cuja função é tornar menos agressivas as transições características das imagens digitais, nas zonas de alto contraste,

- Diversas outras pequenas correções serão também aplicadas, para tornar a imagem o mais próxima possível da nossa realidade.

O conjunto de pixels que compõe a imagem será comprimido para o formato JPEG, ou para outro formato, ou mesmo não comprimido de todo.

Finalmente, será colocada na memória da câmara digital, não sem antes passar por um buffer de armazenamento rápido, cuja velocidade e capacidade irá influenciar a velocidade com que a câmara capta uma ou várias imagens em sequência.

E já está. Aquela imagem da paisagem das montanhas de uma ilha vulcânica, com os navios de cruzeiro parados ao largo, tão bonita ao nosso olhar, está agora transformada em números e pronta para seguir o processo que vimos atrás para ser visualizada no ecrã do monitor.

O que descrevemos pode ser um processo vulgar numa pequena câmara de bolso, com um sensor de pequena dimensão e pouca exigência de qualidade, até mesmo numa pequena câmara digital incorporada num telemóvel, como pode ser um processo não tão vulgar numa câmara DSLR (Digital Single-Lens Reflex) ou até mesmo numa câmara Full Frame.

Os sensores utilizados nas câmaras DSLR, a gama de câmaras que se encontra entre a câmara de bolso e as profissionais Full Frame, são de significativa maior dimensão que os primeiros.

Concretamente, para a mesma resolução, enquanto os primeiros sensores disporão de photosites com até 4,5 mícrones quadrados, os segundos disporão de photosites com até 12 mícrones quadrados. Os sensores das câmaras full frame, com a dimensão da antiga película fotográfica de 35 mm (36 x 24 mm), dispõem de photosites bem maiores, da ordem dos 40 mícrones quadrados.

Conforme cresce a área do photosite, assim cresce a definição da intensidade de energia elétrica carregada em cada fotodiodo pela incidência do respetivo comprimento de onda de luz.

Mas o que é isso de um Photosite?

- Photosite é o nome dado à unidade básica de um sensor, compreendido no espaço de um pixel e composto por:

- 4 fotodiodos;

- 1 matriz de 2×2 mosaicos que os cobrem;

- 4 micro lentes (nos interline transfer sensors – que é o caso dos que estamos a referir);

- Toda a eletrónica necessária para transmitir a informação capturada.

As micro lentes agora referidas não tinham ainda sido mencionadas em representações gráficas porque, para além de serem apenas uma das possíveis soluções para aumentar o efeito da luz nos fotodiodos, iriam certamente complicar a leitura dos elementos fundamentais do photosite nos gráficos. O seu objetivo é concentrar, no local do fotodiodo, toda a luz capturada no seu comprimento de onda. Tal como outras possíveis soluções, estes inserem-se no objetivo comum de aumentar a percentagem de fotões convertidos em eletrões, aumentando assim a semelhança entre os valores capturados e a realidade.

Aproveitamos aqui para evidenciar a diferença entre photosites de 4,5 e 45 mícrones quadrados, usando para isso uma analogia. É semelhante à diferença entre um dedal e um balde, cheios com água. No dedal vai ser muito mais difícil fazer a distinção entre quantidades muito próximas da água que este contém, o que certamente será muito mais evidente no balde.

Voltando à nossa realidade, podemos concluir que, quanto maior for o photosite, e consequentemente, os fotodiodos, maior a possibilidade de diferenciar intensidades muito próximas de cada comprimento de onda de luz, portanto maior será a definição da gama de cores capturada.

Em resumo, as características a ter em conta numa câmara fotográfica digital deverão ser:

- As características do grupo ótico. Quanto melhor o grupo ótico (as lentes, sua organização, abertura máxima do diafragma, etc.) melhor será a informação a chegar ao sensor.

- A dimensão do Photosite. Quanto maior a sua dimensão, maior a quantidade de eletrões que consegue reter sem deitar por fora e melhor qualidade terá a informação transmitida ao microprocessador.

- A quantidade de pixels que compõem a informação de cada fotografia. Quanto maior o seu número, maior será a ampliação que poderá fazer da imagem sem perder definição.

- As características do buffer de armazenamento rápido entre o microprocessador e a memória da câmara. Quanto maior a rapidez desta memória, mais rápida será a execução da fotografia, e quanto maior a sua capacidade, maior número de fotografias pode tirar em sequência rápida.

Claro que, quanto maior ou melhor for cada uma das características atrás referidas, mais cara será a câmara, até chegarmos às Full Frame, com sensores de 36 x 24 mm e photosites com mais de 40 mícrones quadrados de área, com óticas intermutáveis, com 18 a 24 Mega Pixels de resolução e com buffers que permitem tirar fotografias em sequência com intervalos inferiores a 1 segundo.

Mas, como tudo na vida, a melhor solução está no melhor compromisso entre as diversas características. Não vale a pena investir no melhoramento de uma. se não se acompanhar proporcionalmente com as outras, porque nesse caso não tiraremos proveito total do dinheiro gasto.

Devemos sempre ter em conta o que realmente se pretende fazer com as fotografias. A resolução normal para impressão é bem maior do que para ecrã. Se pretendermos grandes ampliações para imprimir então temos que ter maior número de pixels. Mas só nesse caso. Não esqueçamos que a ampliação só fica verdadeiramente boa se cada pixel tiver a informação necessária para o efeito, o que se obtém com um bom grupo ótico e com Photosites de maior capacidade.

Já agora digam lá, de entre duas câmaras que se apresentam no mercado, uma com 5 e outra com 8 Mega Pixels de resolução, por qual optariam?

Pela segunda?

E se, ao perguntarem, lhes dissessem que o chip do sensor tinha a mesma dimensãol em ambas?

Esta fica no ar!

O processo de digitalização de mesa segue aproximadamente os mesmos passos, embora com especificidades próprias do tipo de digitalizador, e do fim a que essas imagens se destinam.